● Presse-Citron

📅 23/03/2026 à 21:02

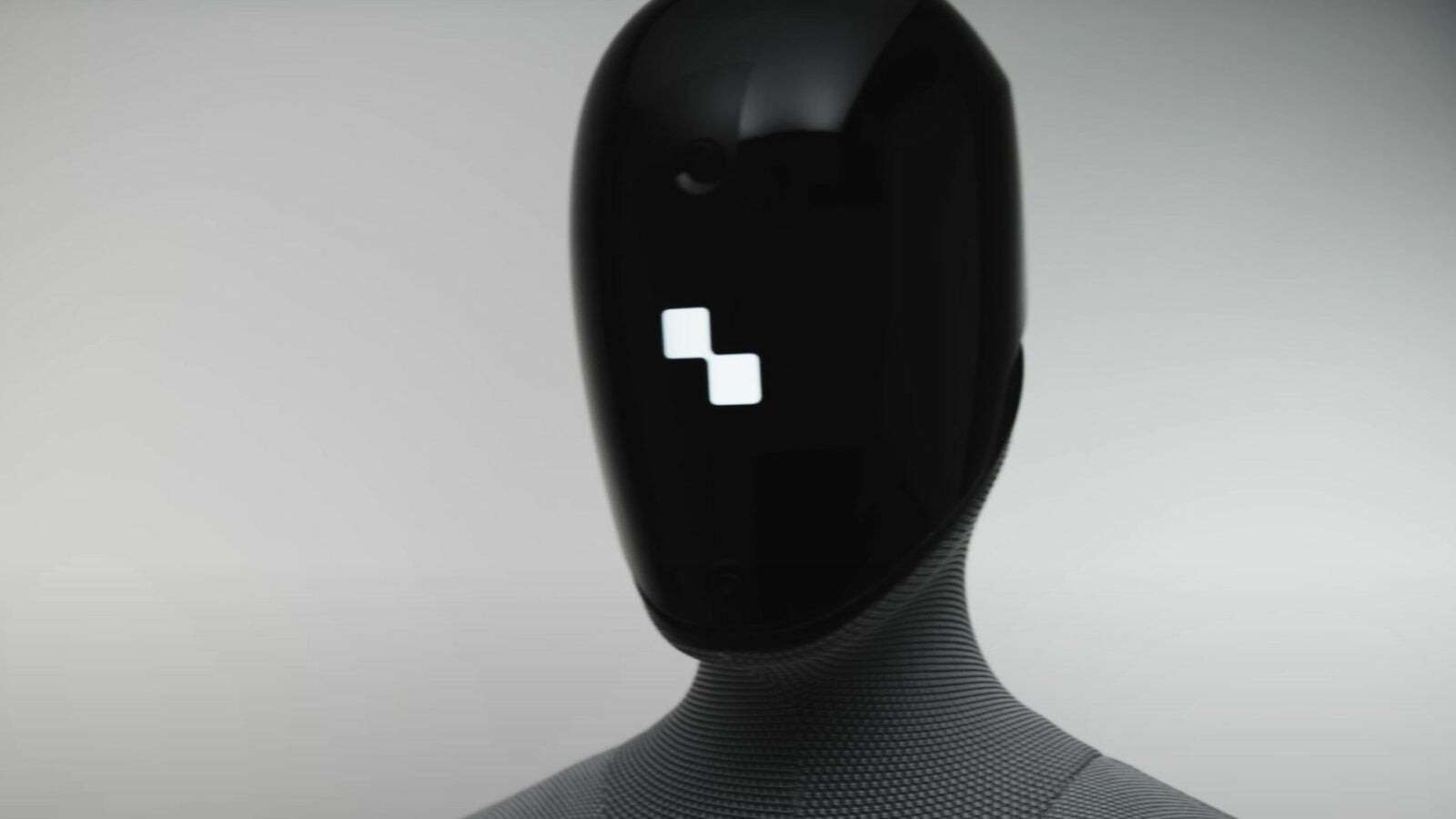

Pourquoi la plupart des robots humanoïdes sont en difficulté face aux tâches simples ?

Géopolitique

👤 Camille Coirault

© Figure / YouTube 0 Il y a 10 ans (déjà !), lorsque Boston Dynamics nous présentait la toute première version de son robot bipède Atlas sur YouTube (voir ci-dessous), nous restions pantois tant il nous semblait futuriste. Il a depuis accompli d’immenses progrès, tout comme le domaine de la robotique de manière générale, qui s’est ouvert et a accueilli de nouveaux acteurs. Nous pensons évidemment à Figure et son Figure 03, l’entreprise chinoise Unitree et son non moins impressionnant G1, ou Tesla et Optimus 3. D’autres entreprises, bien que moins médiatisées, sont au cœur de cette révolution : 1X Technologies, Agility Robotics, Apptronik, Fourier Intelligence… Le secteur est en ébullition et rien ne semble vouloir freiner la marche du progrès. Tous ces robots ont un point commun : ils sont humanoïdes, c’est-à-dire conçus pour évoluer dans un monde fait par et pour des humains. Ils devraient donc, en théorie, agir comme nous : ouvrir et franchir une porte, monter un escalier, manipuler délicatement des objets, travailler aux côtés de leurs créateurs sans nécessiter d’adapter l’environnement à leur morphologie. Toute leur valeur repose sur cette capacité à s’intégrer dans la société, et c’est pour cette raison que le secteur est porté par des investissements titanesques de plusieurs milliards de dollars. Alors, quand on pose la question à deux des esprits les plus brillants du secteur, Scott Kuindersma, ancien ingénieur chez Boston Dynamics, et à Jonathan Hurst d’Agility Robotics, de savoir si leurs robots phares peuvent réellement ouvrir n’importe quelle porte ou monter n’importe quel escalier et qu’ils répondent : « Pas vraiment », on peut s’en étonner. Nous sommes en 2026 et 53 ans se sont écoulés depuis que WABOT 1, le premier robot humanoïde au monde, a réussi à mettre un pied devant l’autre : qu’est-ce qui bloque ? S'abonner à Presse-citron Trois révolutions, et on recommence Depuis dix ans, nous avons assisté à trois immenses changements de paradigme dans le secteur de la robotique. D’abord, le deep learning a transformé en profondeur la manière dont les robots apprennent à se mouvoir. Avant, chaque geste qu’effectuait un robot devait être codé à la main : les ingénieurs modélisaient la physique du robot et résolvaient des équations pour chaque articulation pour anticiper tous les cas de figure imaginables. Un travail de fourmi, et forcément incomplet face à la complexité du monde réel. Désormais, on place le robot dans un simulateur et on entraîne des réseaux de neurones à le contrôler : on leur soumet des millions de situations, on les laisse échouer, recommencer, et s’améliorer. Ils finissent par développer eux-mêmes un ensemble de réflexes pour gérer les imprévus, sans que personne n’ait eu à leur expliquer comment. Ensuite, en 2016, les lourds mécanismes hydrauliques qui actionnaient les membres des robots ont cédé la place à des moteurs électriques dits « proprioceptifs » : une technologie pionnière développée par Sangbae Kim au MIT. Ce sont des éléments motorisés qui sentent les forces qu’ils reçoivent et s’y adaptent en temps réel, comme un muscle qui se tend et se relâche. Les robots ont perdu en rigidité et gagné en agilité, et cela a permis à l’apprentissage par renforcement de réellement se démocratiser. Avant l’existence de ces moteurs, un robot pouvait se casser s’il échouait à reproduire un mouvement qu’on lui avait enseigné lors d’une simulation. Aujourd’hui, les robots humanoïdes sont plus résilients : ils survivent aux aléas de leur environnement en intégrant l’incertitude du monde physique non plus comme une erreur système, mais comme une donnée de base. Enfin, l’irruption des grands modèles de langage dans la robotique a ouvert la troisième porte : le raisonnement. En 2023, Google DeepMind a introduit les modèles « vision-langage-action » : des systèmes qui peuvent ingérer une vidéo, une instruction en langage naturel, et les traduire en commandes de mouvement. Par exemple, si vous dites au robot « j’ai soif », il comprend qu’il doit probablement chercher quelque chose à boire, identifier un récipient, le saisir et vous l’apporter sans qu’un ingénieur ait eu à programmer ces étapes. « C’est quelque chose qu’il y a trois ans encore, il aurait fallu coder à la main », résume Carolina Parada, responsable robotique chez DeepMind. En une décennie, les robots ont appris comment tenir debout et à se mouvoir sans qu’on ait à lui expliquer les lois de la physique. Ils peuvent continuer à marcher même si on leur envoie un parpaing dans le thorax parce que leurs moteurs proprioceptifs les ont rendus « physiquement intelligents ». Ils comprennent nos instructions et peuvent planifier et exécuter des tâches dont la liste s’allonge de jour en jour. Mais il leur manque toujours quelque chose d’essentiel qu’on pourrait presque se dire aujourd’hui que cette problématique aurait dû être résolue avant qu’ils ne gagnent toutes ces compétences : la capacité à interagir avec le monde et à le ressentir comme nous le faisons. Le sens du toucher : le talon d’Achille des robots humanoïdes Selon Pulkit Agrawal, du laboratoire Improbable AI du MIT : « Pour que les robots fonctionnent comme des humains, il faut maîtriser la physique » Attention : en aucun cas il ne s’agit de concepts complexes comme la relativité générale ou la physique quantique, non. La physique de base, que l’on enseigne en terminale scientifique, que tout lycéen a vue sur un tableau noir, et que les robots humanoïdes les plus avancés du monde ne maîtrisent toujours pas vraiment : les principes de force et d’inertie. Un qui déplace son bras d’un point A à un point B en sachant exactement où ce point se trouve, c’est un robot qui contrôle ses mouvements. Les robots actuels le font sans aucun problème. Mais un robot qui sent la résistance de ce qu’il touche, qui ajuste la pression qu’il exerce selon que l’objet est fragile ou solide, lourd ou léger, fixe ou mobile, c’est un robot qui ressent ses mouvements. C’est une toute autre affaire. Certains en sont capables, comme Figure 03, par exemple, mais au prix d’une lenteur considérable : c’est une forme de compensation, de substitution à l’absence du ressenti. Un robot qui ne sent pas les forces qu’il exerce ne peut pas corriger ses erreurs en temps réel : il commet inévitablement de petits écarts de positionnement qu’il ne perçoit pas. À une vitesse qui nous paraîtrait « humaine », le nombre de bourdes empirerait. En revanche, si le robot peut ralentir suffisamment, son logiciel interne a le temps de corriger : il ne ressent pas ce qu’il fait, mais il le fait si lentement qu’il a le temps de voir venir. C’est pourquoi c’est l’une des priorités de la robotique humanoïde : nous pouvons prendre en exemple le système SonicSense, qui utilise les signaux acoustiques pour simuler le contact physique. D’autres existent, bien sûr, comme DIGIT (Meta AI/GelSight) à l’aide de mini-caméras ou SynTouch (BioTac) qui tente de copier l’anatomie humaine. Nous sommes en pleine transition de la « robotique de positionnement » (le robot exécute un mouvement) vers la « robotique de conditionnement » (le robot réagit à son environnement physique) : peut-être est-ce là le quatrième paradigme ? Si Charles Darwin avait été encore de ce monde, sûrement aurait-il trouvé cette phase de stagnation plutôt cocasse : ce qui arrête les robots les plus évolués du monde est exactement ce qu’ont développé les premiers organismes multicellulaires à leurs débuts. La bonne nouvelle, c’est de savoir cette problématique soit reconnue ; la moins bonne, c’est que rattraper 500 millions d’années d’évolution ne sera pas tâche aisée. Les robots humanoïdes, malgré des avancées technologiques majeures, peinent à exécuter des tâches simples comme ouvrir une porte ou éplucher une orange. Leurs difficultés proviennent d’un manque de sensation physique, ce qui les empêche de s’ajuster en temps réel aux interactions avec leur environnement. Des innovations en robotique, comme les moteurs proprioceptifs et les modèles de langage, ont amélioré leurs capacités, mais le développement du sens du toucher reste un défi crucial. 📍 Pour ne manquer aucune actualité de Presse-citron, suivez-nous sur Google Actualités et WhatsApp. Newsletter 🍋 Abonnez-vous, et recevez chaque matin un résumé de l’actu tech Votre email : Je m'inscris J'ai lu et accepte les termes et les conditions Laissez ce champ vide si vous êtes humain : iarobotScience [ Source ] Sur le même sujet Réchauffement climatique : dans ce glacier en pleine fonte, des traces de pollution du Moyen Âge refont surface Un chercheur pense avoir résolu un mystère vieux de cinq siècles dans un dessin de Léonard de Vinci Réchauffement climatique : la montée des océans ralentit la rotation de la Terre Jeff Bezos veut racheter l’industrie traditionnelle pour l’automatiser avec l’IA : un plan à 100 milliards de dollars Les dernières actualités Pourquoi la plupart des robots humanoïdes sont en difficulté face aux tâches simples ? Où acheter le Nothing Phone (4a) Pro au meilleur prix ? Mark Zuckerberg développerait un agent IA pour l’aider à diriger Meta « J’en ai marre de cette censure systématique » : LCI diffuse par erreur des messages WhatsApp avec son envoyé spécial en Iran « Une fausse tentative d’assassinat » : pour qu’Orbán remporte les élections en Hongrie, Moscou a préparé une mesure extrême Le OnePlus 15 tombe de -35% : puissance de feu et autonomie de chameau à prix choc 💥 Donald Trump arrête les frappes sur l’Iran : voici 6 raisons qui expliquent ce retournement de situation Magic V2 : son prix dégringole de -75%, Honor plie le game des smartphones pliables

🔗 Lire l'article original

👁️ 3 lectures